Van chatbot naar handelende assistent: wat OpenClaw zichtbaar maakt over kosten, lock-in en autonomie

- Bernard Donners

- 27 apr

- 7 minuten om te lezen

Bijgewerkt op: 5 dagen geleden

"Only drug dealers and software companies call their customers 'users'", schreef Edward Tufte ooit. Met de huidige golf aankondigingen van AI-Agents waaronder Anthropic Claude Cowork, OpenAI ChatGPT Codex is dit een goede metafoor omdat het AI verdienmodel erop gebouwd is uiteindelijk je tokenverbruik te laten groeien met je afhankelijkheid.

Met de introductie van OpenClaw, eind 2025, ben ik daarom een tegenexperiment begonnen: kan ik een AI-assistent bouwen die voor míj werkt, niet voor het platform?

OpenClaw is geen gewone chatbot. Het is een open-source agent-harness waarmee je geen losse chatbot bouwt maar een digitale collega met context, werkgeheugen, routines en duidelijke grenzen.

Om mijn werkomgeving gescheiden te houden van mijn dagelijkse Macbook draai ik het OpenClaw experiment op een aparte MacMini M4 van €600. Strikt nodig is dat niet, je kunt OpenClaw ook in een Docker-container op je laptop installeren of in de cloud via een VPS draaien.

Mijn doel is om op termijn zo autonoom mogelijk te werken op eigen hardware: terug naar het lokaal-rekenen van vóór het cloudtijdperk, met een lokale AI en slechts de elektriciteitsrekening van de Mac Mini als terugkerende kostenpost!

Van prompt naar werkomgeving

Eerst even terug naar de basis. De meeste mensen kennen AI nog als iets waar je een vraag aan stelt. Je typt een prompt in ChatGPT, Claude of Gemini en krijgt antwoord terug. Dat is nuttig, soms indrukwekkend, maar het blijft meestal binnen het kader van één gesprek.

De essentie van OpenClaw is eenvoudig: je bouwt een digitale collega met context, werkgeheugen, routines en duidelijke grenzen. Dat is het eerder gememoreerde harness: de softwarelaag rond het model die context, geheugen, tools en routines organiseert.

Drie verschuivingen die agentic AI zichtbaar maakt

Voor wie deze introductie iets te snel gaat: In mijn video ‘Masterclass OpenClaw voor beginners’, opgenomen op 25 april 2026 tijdens mijn lezing op de Carrièrebeurs in Amsterdam, laat ik de praktische kant zien. Daarbij benoem ik 3 interessante verschuivingen ten opzichte van de chatbots.

De eerste is dat de interface verschuift van scherm naar intentie. Je zegt niet meer alleen wat je wilt weten, maar ook wat je gedaan wilt hebben. De agent moet dan niet alleen taal begrijpen, maar ook context, prioriteit, timing en risico.

De tweede is dat geheugen belangrijker wordt dan één goed antwoord. Een bruikbare agent moet onthouden wie je bent, hoe je werkt, wat eerder is afgesproken en wat wel of niet gevoelig ligt. Dit is voor het dagelijkse gebruik operationele noodzaak.

De derde is dat orchestratie belangrijker wordt dan alleen intelligentie. Een model kan slim zijn, maar zonder tools, permissies, geheugen, timing en begrenzing blijft het een aanmodderen. Juist de combinatie van al die lagen maakt een agent bruikbaar.

De architectuur achter een werkende agent

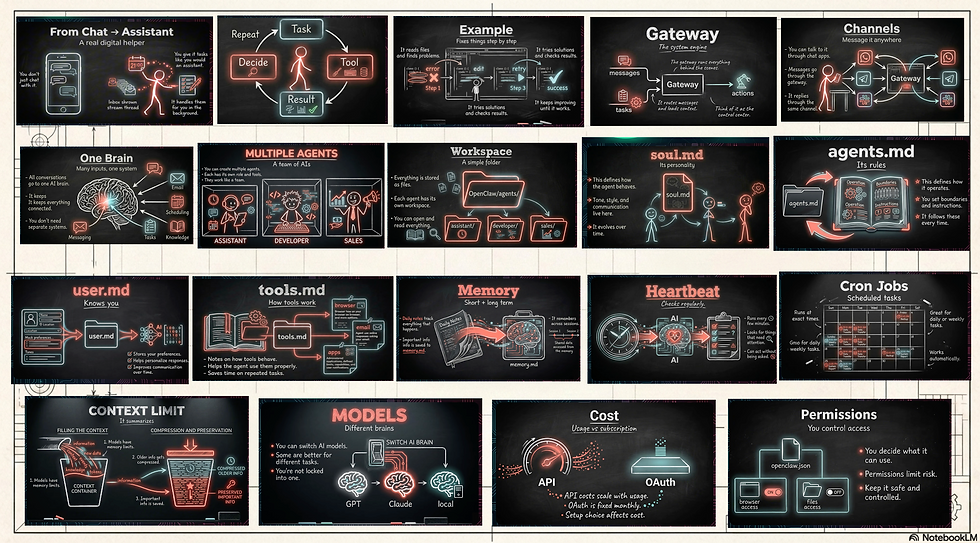

Wat ik sterk vind aan OpenClaw, is dat de open source architectuur zichtbaar is. Je ziet vrij expliciet welke bouwstenen nodig zijn om van AI een werkend systeem te maken.

- een persoonlijkheidslaag via bijvoorbeeld `soul.md`

- gebruikerscontext via `user.md`

- geheugen in de vorm van korte en lange termijn notities

- geplande acties via cron jobs

- periodieke controles via heartbeats

- toegang tot tools, browseracties, bestanden en andere workflows

- de mogelijkheid om met verschillende modellen te werken, afhankelijk van de taak.

In het bovenstaande plaatje zie je dat mooi terug. Een agent heeft niet alleen een prompt nodig, maar ook een karakterlaag, gebruikerscontext, lange termijn geheugen, taken die op de achtergrond draaien, en een afbakening van wat wel en niet mag.

De komende golf van AI-adoptie zal minder draaien om losse apps en meer om agentic infrastructuur, maar die zit bij de modellen van OpenAI en Anthropic dus verstopt in een Black Box.

En hier is dan ook de eerste issue die besproken moet worden: De (token)kosten en het verdienmodel hebben een sluimerend vendor lock-in risico omdat deze agentic assistenten diep geïntegreerd worden met je workflows bij de aanbieder.

25 jaar geleden zeiden wij al in Silicon Valley "everything you do with Microsoft has a price in time" en dat zal hier met de big 5 in AI (OpenAI, Anthropic, Google, Microsoft en Nvidia) niet anders zijn.

Hier heeft het open source OpenClaw model van Peter Steinberger dus al zijn eerste intrinsieke voordeel.

Van demo naar praktijk

Maar veel organisaties zitten nog in de fase van experimenteren met prompts. Dat is logisch. Maar die fase is dus eindig.

Inmiddels ontwikkelen OpenAI met ChatGPT/Codex en Anthropic met Claude/Cowork dus ook hun volwaardige agents die de desktop van je laptop kunnen overnemen. In het geval van Codex kan dat ook op de achtergrond, terwijl jij je laptop blijft gebruiken.

Maar in dit nieuwe speelveld doen de agents grotendeels hetzelfde.

- een agent die e-mail samenvat

- een agent die agenda’s bewaakt

- een agent die terugkerende controles uitvoert

- een agent die informatie uit meerdere bronnen samenbrengt

- een agent die via een browser of tool een taak probeert af te ronden

- meerdere gespecialiseerde agents die samenwerken als team

In mijn OpenClaw presentatie (zie link bij de bronvermelding, beneden) en in de video gebruik ik ook voorbeelden als de digitale conciërge, de AI-sommelier en predictive hospitality. Die voorbeelden zijn niet alleen bedoeld als leuke demo’s. Ze laten zien dat de kern van deze ontwikkeling ligt in samenspel tussen data, context, timing en actie.

Toepassingen als interne helpdesk voor een accountantskantoor, klant-onboarding, e-commerce retourbeleid, afspraken en herinneringen uitsturen voor een tandartspraktijk of restaurant zijn met OpenClaw reeds werkende use cases.

Open source en kostencontrole

Mijn doel is dus om op termijn zo autonoom mogelijk te werken op eigen hardware: terug naar het lokaal-rekenen van vóór het cloudtijdperk, maar dan met AI.

Daar zit meteen het eerste verschil met de agents van Anthropic en OpenAI: OpenClaw is open source en geeft je veel meer grip op de tokenkosten. Voor routinetaken laat ik Felix draaien op MiniMax M2.5, een Chinees open source model dat, afhankelijk van input of output, grofweg 20× goedkoper is dan Anthropic's topmodel Claude Opus 4.6. De duurdere Claude-tokens zet Felix alleen in als dat echt nodig is. Daarnaast benut hij het abonnementsmodel van ChatGPT/Codex zolang die gebruikslimieten nog niet bereikt zijn.

Dit is overigens een tussenstap zolang ik nog API's gebruik (de eindstap is een lokaal LLM).

Er is bovendien een tweede reden waarom dit verschil ertoe doet: vendor lock-in. Wie zijn agenda, mail, bestanden en workflows diep integreert met Cowork of Codex, bouwt vandaag productiviteit op en morgen een switching cost. De prijzen zullen omhoog gaan zodra de afhankelijkheid groot genoeg is. Een open-source harness als OpenClaw houdt die laag in eigen hand: je kunt onderliggende modellen wisselen zonder je werkprocessen overnieuw te bouwen.

Dit zijn zaken die op CIO- en CFO-niveau besproken dienen te worden. Hoe dieper een organisatie integreert met één AI-vendor, hoe minder onderhandelingsruimte er overblijft als de prijs omhoog gaat. Medewerkers die hun workflows volledig om één model heen bouwen, bouwen dus onbedoeld mee aan de afhankelijkheid van hun werkgever.

Wat zwaarder weegt zodra een agent gaat handelen

Zodra een agent niet alleen antwoordt maar ook handelt, worden de zwakke plekken meteen zichtbaar. Dan gaat het direct over:

- privacy

- security

- rechtenstructuren

- explainability

- betrouwbaarheid

- fouttolerantie

- menselijke controle

Dat zie je ook in OpenClaw zelf terug. Permissions zijn geen detail, maar een fundament. Een agent moet alleen toegang hebben tot wat expliciet is toegestaan. Het principe van least privilege is hier geen theoretische securitytaal, maar gewoon gezond verstand.

Ook is contextbeheer belangrijk. Elk model heeft grenzen in zijn context window. Dus moet je keuzes maken over wat tijdelijk is, wat samengevat wordt, en wat langdurig bewaard moet blijven. Wie dat niet goed organiseert, bouwt geen betrouwbare agent maar een vergeetachtige improvisator, wat ook in de Carrièrebeurs video van de masterclass goed wordt geïllustreerd met Felix in de sommelier case.

En tenslotte: niet alles wat geautomatiseerd kan worden, moet je ook automatiseren. Zeker niet in sectoren waar vertrouwen, empathie, reputatie of gastvrijheid centraal staan. Focus voor de toepassing van AI op Repetitive, rulebased tasks in a defined frame die dan een organisatie echt kan laten focuseren op klanten of een AI assistent die, zoals in mijn geval, mij helpt bij het offloaden van zaken in plaats van het outsourcen.

Waarom dit commercieel relevant wordt

Voor mij is dit ook meer dan een technisch experiment en mogelijk zelfs een nieuw verdienmodel.

Omdat de behoefte snel groeit aan mensen die niet alleen over AI kunnen praten, maar die ook begrijpen hoe je agenten ontwerpt, begrenst, test, positioneert en laat landen in de praktijk.

Daar zit straks waarde in op minstens vier niveaus:

- strategie: wat betekent agentic AI voor businessmodel, klantcontact en operatie, én hoe voorkom je dat je organisatie zich vastketent aan één vendor?

- architectuur: hoe organiseer je memory, tools, permissions, workflows en modelkeuze?

- adoptie: hoe neem je teams mee in verantwoord experimenteren?

- toepassing: welke use cases leveren tijdwinst en kwaliteit en maken echt het verschil?

Met andere woorden: de markt verschuift van kun je iets met ChatGPT? naar kun je een bruikbare agent-omgeving ontwerpen die veilig, nuttig en qua kosten beheersbaar is?

Tot slot

Mijn experimenten met Felix hebben mij laten zien hoe belangrijk de architectuur rondom AI wordt. De komende maanden werk ik dit verder uit op een Mac Studio met een lokaal LLM, zodat ik autonoom mijn assistent kan laten functioneren zonder API-afhankelijkheid en met alleen de elektriciteitsrekening als vaste kostenpost.

Geen "user" meer zijn van een platform, maar eigenaar van mijn eigen AI-laag. Dat is voor mij de richting en belangrijk, denk ik, niet alleen voor individuen maar ook voor organisaties die niet willen eindigen als gevangene van hun eigen productiviteitssprong.

Bronvermelding

1. BernardDonners-ai.nl: thought leadership

- We staan aan de vooravond van een nieuw economisch internetmodel

- Succesvolle AI-Implementatie in Organisaties: Van Theorie naar Praktijk

- Korte bloemlezing over AI-leiderschap, verandermanagement en onderwijs

2. YouTube video Bernard Donners

- "Masterclass OpenClaw" voor beginners

3. Carrierebeurs

Predictive Hospitality

- Claude Cowork Artifact Dashboard

NotebookLM video samenvatting van de keynote tijdens de carrierebeurs op de RAI

𝐓𝐢𝐞𝐧 𝐣𝐚𝐚𝐫 𝐠𝐞𝐥𝐞𝐝𝐞𝐧 𝐰𝐚𝐬 𝐀𝐖𝐒 𝐬𝐩𝐨𝐭𝐠𝐨𝐞𝐝𝐤𝐨𝐨𝐩. 𝐈𝐞𝐝𝐞𝐫𝐞𝐞𝐧 𝐦𝐢𝐠𝐫𝐞𝐞𝐫𝐝𝐞, 𝐞𝐧 𝐳𝐨𝐝𝐫𝐚 𝐝𝐞 𝐦𝐚𝐫𝐤𝐭 𝐯𝐚𝐬𝐭𝐳𝐚𝐭, 𝐤𝐰𝐚𝐦𝐞𝐧 𝐝𝐞 𝐯𝐞𝐫𝐡𝐨𝐠𝐢𝐧𝐠𝐞𝐧. Azure ging in 2025 met 10 tot 12 procent omhoog, AWS verhoogt EC2-prijzen jaar op jaar, en voor Q2 2026 worden er nóg eens 5 tot 10 procent verhogingen verwacht.Met AI gaat exact hetzelfde gebeuren. Misschien sneller. Want OpenAI kan zich geen 14 miljard verlies per jaar blijven permitteren. Op een gegeven moment komt de rekening, en die wordt bij jou neergelegd.En als jouw hele bedrijfsproces tegen die tijd vastzit? Lock-in compleet. 𝐃𝐮𝐬 𝐣𝐞 𝐡𝐞𝐛𝐭 𝐚𝐛𝐬𝐨𝐥𝐮𝐮𝐭 𝐞𝐞𝐧 𝐩𝐮𝐧𝐭!